Zespół naukowców z Politechniki w Delft opracował drona, który lata autonomicznie, wykorzystując neuromorficzne przetwarzanie obrazu i kontrolę w oparciu o działanie mózgów zwierząt.

Mózgi zwierząt zużywają mniej danych i energii w porównaniu z obecnymi głębokimi sieciami neuronowymi działającymi na procesorach graficznych (chipach graficznych). Procesory neuromorficzne doskonale nadają się zatem do małych dronów, ponieważ nie wymagają ciężkiego i dużego sprzętu ani baterii. Wyniki są niezwykłe: podczas lotu głęboka sieć neuronowa drona przetwarza dane nawet 64 razy szybciej i zużywa trzy razy mniej energii niż w przypadku pracy na GPU. Dalszy rozwój tej technologii może sprawić, że drony staną się tak małe, zwinne i inteligentne jak latające owady czy ptaki. Wyniki opublikowano niedawno w czasopiśmie Science Robotics.

Sztuczna inteligencja ma ogromny potencjał, jeśli chodzi o zapewnienie autonomicznym robotom inteligencji potrzebnej do zastosowań w świecie rzeczywistym. Jednak obecna sztuczna inteligencja opiera się na głębokich sieciach neuronowych, które wymagają znacznej mocy obliczeniowej. Procesory przeznaczone do obsługi głębokich sieci neuronowych (jednostki przetwarzania grafiki, procesory graficzne) zużywają znaczną ilość energii. Stanowi to problem szczególnie w przypadku małych robotów, takich jak latające drony, ponieważ mogą one przenosić jedynie bardzo ograniczone zasoby w zakresie wykrywania i przetwarzania danych.

Mózgi zwierząt przetwarzają informacje w sposób bardzo odmienny od sieci neuronowych działających na procesorach graficznych. Neurony biologiczne przetwarzają informacje asynchronicznie i komunikują się głównie za pomocą impulsów elektrycznych zwanych impulsami. Ponieważ wysyłanie takich impulsów kosztuje energię, mózg minimalizuje impulsy, co prowadzi do rzadkiego przetwarzania.

Zainspirowani właściwościami mózgów zwierząt naukowcy i firmy technologiczne opracowują nowe, neuromorficzne procesory. Te nowe procesory umożliwiają uruchamianie sieci neuronowych typu „speaking” i zapewniają, że będą znacznie szybsze i bardziej energooszczędne.

„Obliczenia wykonywane przez sieci neuronowe typu spike są znacznie prostsze niż w standardowych głębokich sieciach neuronowych” – mówi Jesse Hagenaars, doktorant i jeden z autorów artykułu. „Podczas gdy cyfrowe neurony typu spike muszą jedynie dodawać liczby całkowite, standardowe neurony mają mnożyć i dodawać liczby zmiennoprzecinkowe. Dzięki temu tworzenie sieci neuronowych typu impulsowego jest szybsze i bardziej energooszczędne. Aby zrozumieć dlaczego, pomyśl o tym, że ludziom znacznie łatwiej jest obliczyć 5 + 8 niż 6,25 x 3,45 + 4,05 x 3,45.

Ta efektywność energetyczna jest dodatkowo zwiększona, jeśli procesory neuromorficzne są stosowane w połączeniu z czujnikami neuromorficznymi, takimi jak kamery neuromorficzne. Takie kamery nie wykonują zdjęć w ustalonych odstępach czasu. Zamiast tego każdy piksel wysyła sygnał tylko wtedy, gdy staje się jaśniejszy lub ciemniejszy. Zaletami takich kamer jest to, że znacznie szybciej dostrzegają ruch, są bardziej energooszczędne i dobrze działają zarówno w ciemnym, jak i jasnym otoczeniu. Co więcej, sygnały z kamer neuromorficznych mogą być przesyłane bezpośrednio do sieci neuronowych działających na procesorach neuromorficznych. Razem mogą stworzyć ogromny potencjał dla robotów autonomicznych, zwłaszcza małych, zwinnych robotów, takich jak latające drony.

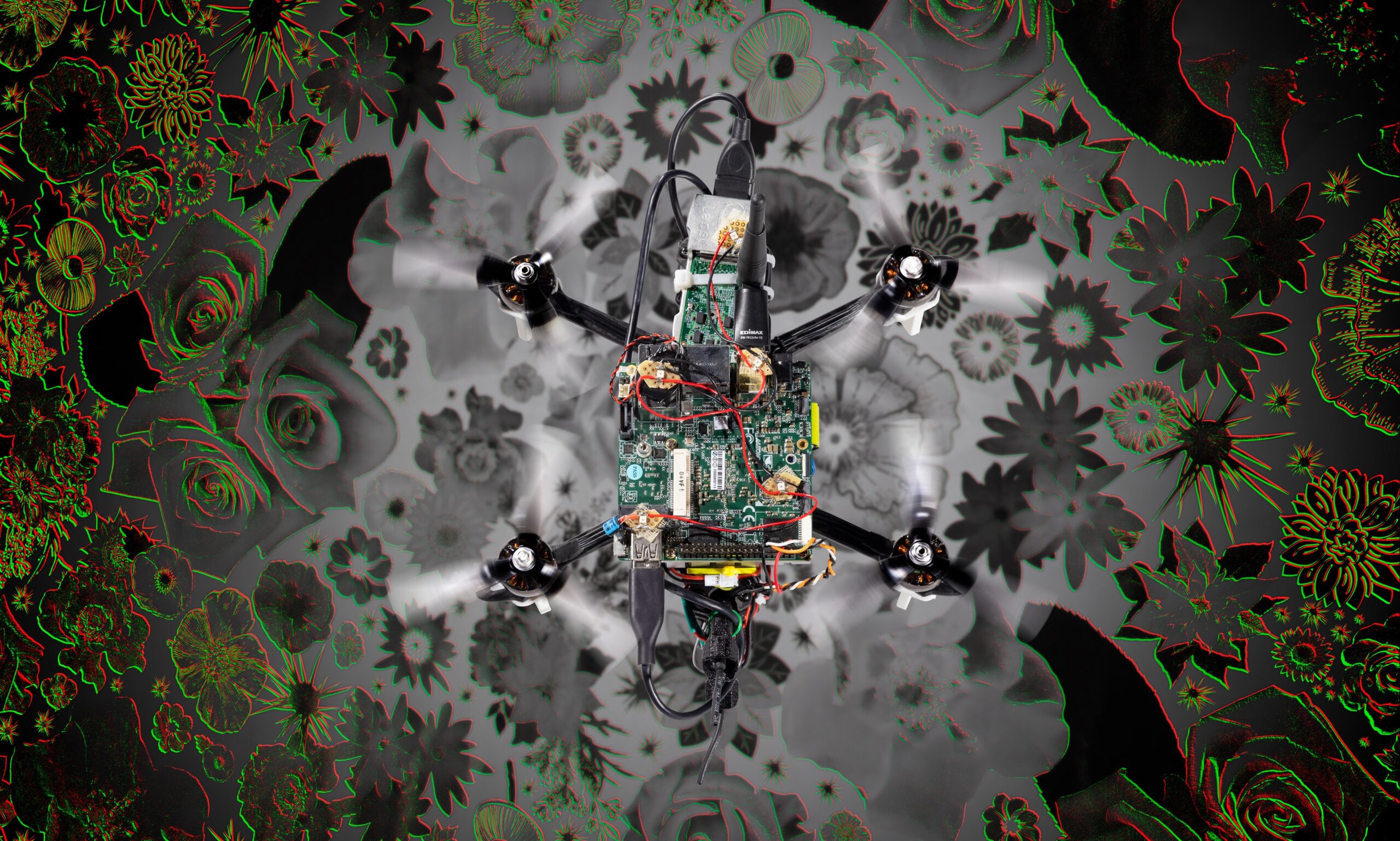

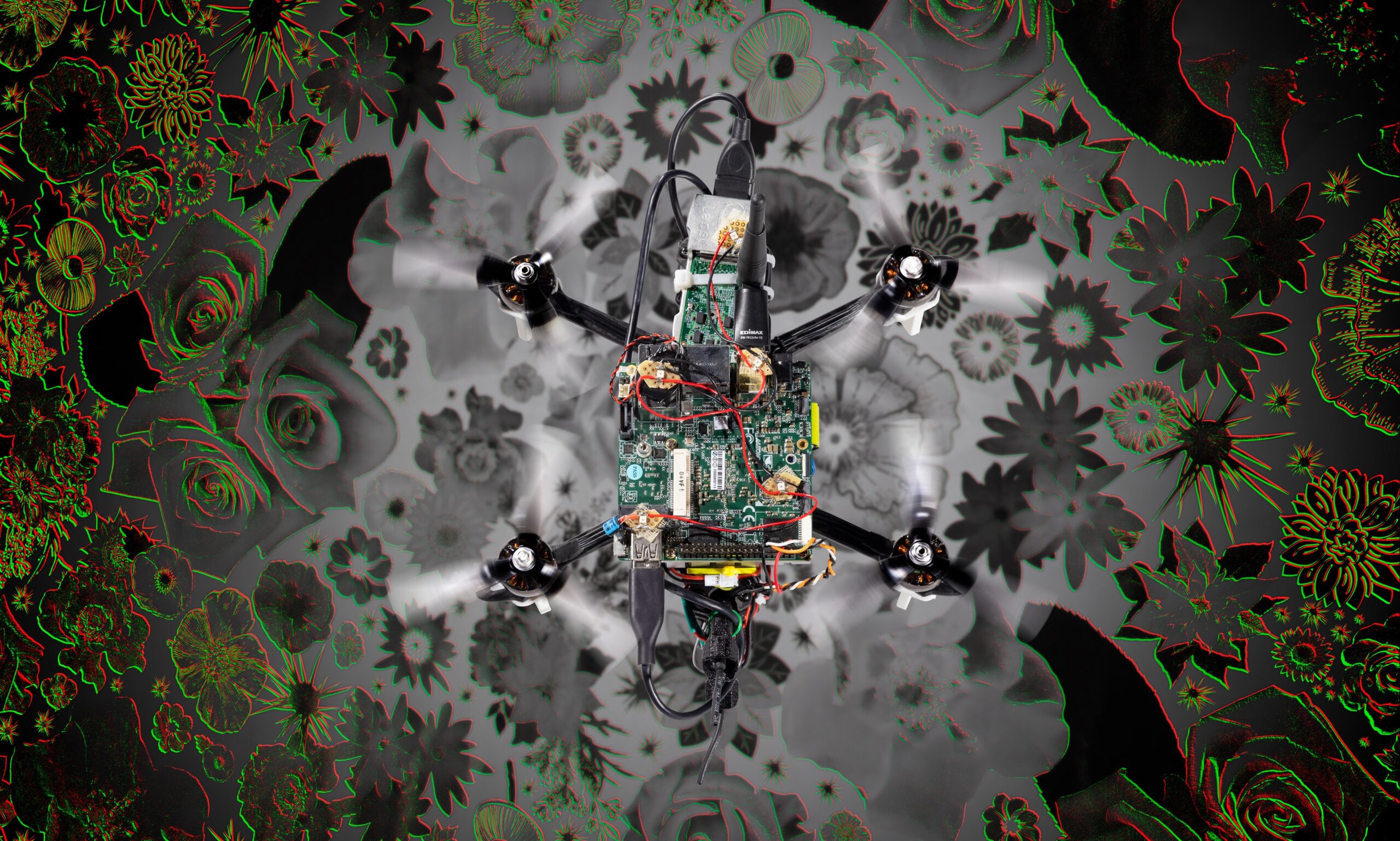

W artykule opublikowanym w Science Robotics 15 maja 2024 r. naukowcy z Uniwersytetu Technologicznego w Delft w Holandii po raz pierwszy demonstrują drona, który wykorzystuje neuromorficzne widzenie i kontrolę do autonomicznego lotu. W szczególności opracowali impulsową sieć neuronową, która przetwarza sygnały z kamery neuromorficznej i wysyła polecenia sterujące, które określają pozycję i ciąg drona. Wdrożyli tę sieć w neuromorficznym procesorze, neuromorficznym chipie badawczym Loihi firmy Intel, znajdującym się na pokładzie drona. Dzięki sieci dron może postrzegać i kontrolować własny ruch we wszystkich kierunkach.

– Staliśmy przed wieloma wyzwaniami – mówi Federico Paredes-Vallés, jeden z badaczy biorących udział w badaniu – ale najtrudniejsze było wyobrażenie sobie, w jaki sposób moglibyśmy wytrenować sieć neuronową o impulsowym działaniu, tak aby szkolenie było zarówno wystarczająco szybkie, jak i wytrenowane sieć będzie dobrze działać na prawdziwym robocie. Ostatecznie zaprojektowaliśmy sieć składającą się z dwóch modułów. Pierwszy moduł uczy się wizualnie postrzegać ruch na podstawie sygnałów poruszającej się kamery neuromorficznej. Robi to całkowicie samodzielnie, w sposób samonadzorowany, bazując wyłącznie na danych z kamery. Przypomina to proces, w jaki zwierzęta uczą się samodzielnie postrzegać świat. Drugi moduł uczy się mapować szacunkowy ruch na polecenia sterujące w symulatorze. Uczenie się to opierało się na sztucznej ewolucji w symulacji, w której sieci lepiej kontrolujące drona miały większe szanse na spłodzenie potomstwa. W ciągu pokoleń sztucznej ewolucji, sieci neuronowe stawały się coraz lepsze pod kontrolą i w końcu mogły latać w dowolnym kierunku z różnymi prędkościami. Przeszkoliliśmy oba moduły i opracowaliśmy sposób, w jaki możemy je połączyć. Byliśmy szczęśliwi, że połączona sieć od razu dobrze zadziałała na prawdziwym robocie.

Dzięki neuromorficznemu widzeniu i kontroli dron może latać z różnymi prędkościami w różnych warunkach oświetleniowych, od ciemnego do jasnego. Może nawet latać z migoczącymi światłami, co sprawia, że piksele w kamerze neuromorficznej wysyłają do sieci ogromną liczbę sygnałów niezwiązanych z ruchem.

„Co ważne, nasze pomiary potwierdzają potencjał neuromorficznej sztucznej inteligencji. Sieć działa średnio od 274 do 1600 razy na sekundę. Jeśli uruchomimy tę samą sieć na małym, wbudowanym procesorze graficznym, będzie ona działać średnio tylko 25 razy na sekundę, co stanowi różnicę ~10-64! Co więcej, podczas pracy sieci neuromorficzny chip badawczy Loihi firmy Intel zużywa 1,007 wata, z czego 1 wat to moc w stanie bezczynności, którą procesor zużywa właśnie po włączeniu chipa. Samo uruchomienie sieci kosztuje jedynie 7 miliwatów. Dla porównania, podczas pracy w tej samej sieci wbudowany procesor graficzny zużywa 3 waty, z czego 1 wat to moc w stanie bezczynności, a 2 waty są wydawane na działanie sieci. Podejście neuromorficzne skutkuje sztuczną inteligencją, która działa szybciej i wydajniej, umożliwiając wdrażanie na znacznie mniejszych autonomicznych robotach” – mówi Stein Stroobants, doktorant w dziedzinie dronów neuromorficznych.

Pierwszy dron latający z pełną neuromorficzną sztuczną inteligencją i kontrolą wizji.

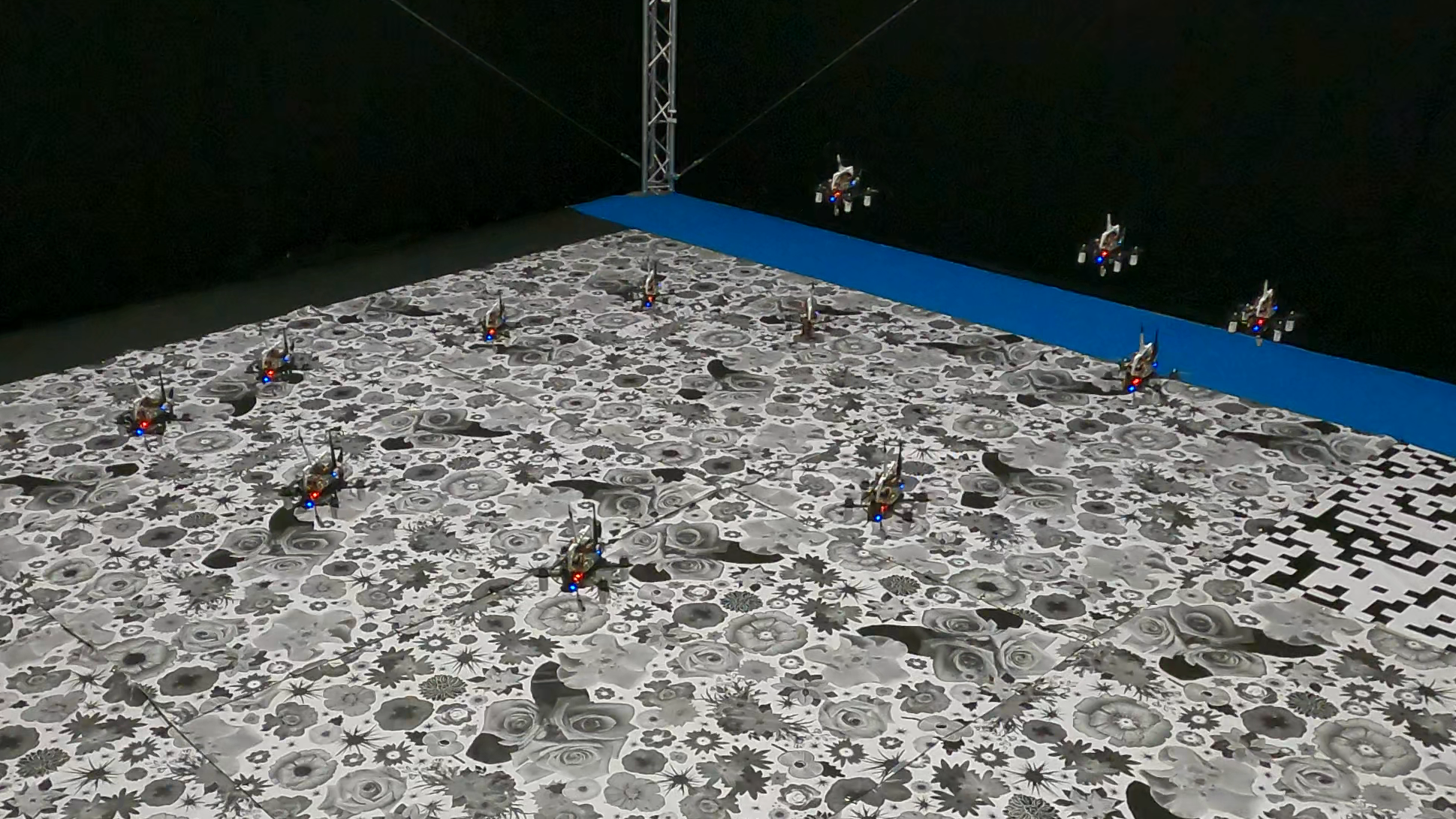

„Neuromorficzna sztuczna inteligencja sprawi, że wszystkie autonomiczne roboty będą bardziej inteligentne” – mówi Guido de Croon, profesor zajmujący się dronami inspirowanymi biologią, „ale jest to absolutny czynnik umożliwiający rozwój małych autonomicznych robotów. Na Wydziale Inżynierii Lotniczej Politechniki Delft pracujemy nad małymi autonomicznymi dronami, które można wykorzystać do różnych zastosowań, od monitorowania upraw w szklarniach po śledzenie zapasów w magazynach. Zaletą małych dronów jest to, że są bardzo bezpieczne i mogą poruszać się w wąskich przestrzeniach, np. pomiędzy rzędami sadzonek pomidorów.

Co więcej, mogą być bardzo tanie, dzięki czemu można je stosować w rojach. Jest to przydatne do szybszego pokrycia obszaru, jak pokazaliśmy w ustawieniach eksploracji i lokalizacji źródeł gazu.

„Obecne prace są wielkim krokiem w tym kierunku. Jednak realizacja tych zastosowań będzie zależała od dalszego zmniejszania rozmiaru sprzętu neuromorficznego i rozszerzania jego możliwości w kierunku bardziej złożonych zadań, takich jak nawigacja”.

Zdjęcia w tekście: materiały Politechniki w Delft (2)

Zostaw komentarz

You must be logged in to post a comment.