– Definicję opublikowaliśmy na LinkedIn, co ku naszemu zaskoczeniu spotkało się z niespotykaną wcześniej liczbą komentarzy – piszą – eksperci OECD.AI prof. Stuart Russel, Karine Perset i Marko Grobelnik. – Chcemy lepiej odpowiedzieć na zainteresowanie, jakie nasza społeczność wykazała definicją, krótkim wyjaśnieniem powodów aktualizacji i samej definicji. Jeszcze w tym roku będziemy mogli udostępnić jeszcze więcej szczegółów, gdy zostaną już sfinalizowane.

Poniżej znajdują się szczegółowe zmiany w aktualnym tekście definicji „systemu AI”, z dodatkami zaznaczonymi pogrubieniem i przekreśleniami ) :

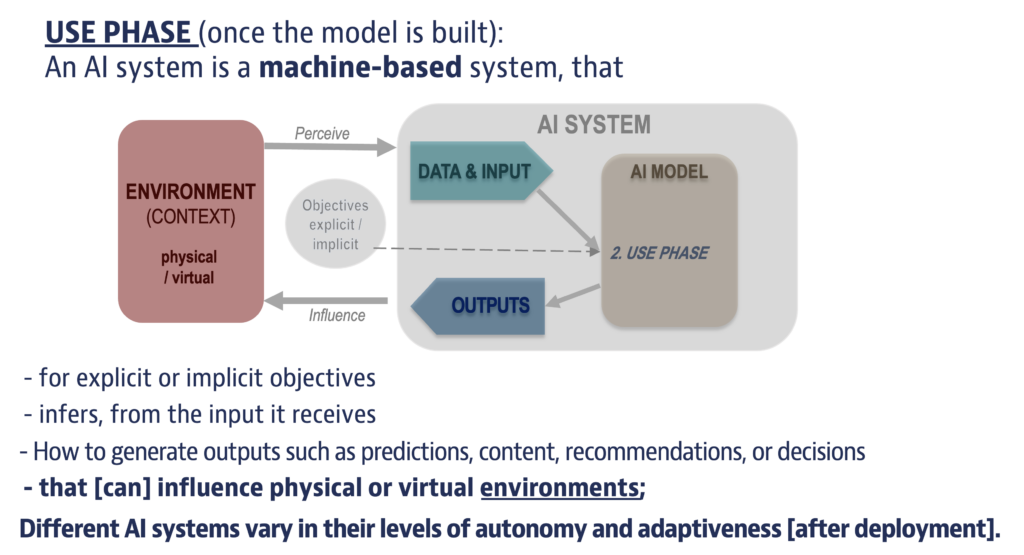

System sztucznej inteligencji to system oparty na maszynach , który w przypadku

danego zestawu zdefiniowanych przez człowiekacelów , jawnych lub ukrytych ,możewywnioskować na podstawie otrzymanych danych wejściowych, w jaki sposób wygenerować wyniki, takie jakprzewidywania, treść , zalecenia lub decyzje , które mogą wpływanie na fizyczne, rzeczywistelub wirtualne środowiska. Różne systemy sztucznej inteligencjiprojektuje się tak, aby po wdrożeniu działały zróżnym poziomemautonomiii zdolności adaptacyjnych

Opis celów : te zmiany mają na celu odzwierciedlenie konsensusu naukowego co do tego, że cele systemu sztucznej inteligencji mogą być jednoznaczne (np,jeśli są bezpośrednio zaprogramowane w systemie przez programistę) lub ukryte (np,poprzez zbiór reguł określonych przez człowieka lub gdy system jest w stanie uczyć się nowych celów).

Przykłady systemów z ukrytymi celami obejmują systemy autonomiczne, które są zaprogramowane tak, aby były zgodne z przepisami ruchu drogowego (ale nie „znają” swojego ukrytego celu, jakim jest ochrona życia), lub duży model językowy, taki jak ChatGPT, w którym celemSsystemuCzynie są wyraźnie zaprogramowane, ale nabyte częściowo w procesie uczenia się naśladowczego z tekstu generowanego przez człowieka, a częściowo w procesie uczenia się przez wzmacnianie na podstawie informacji zwrotnych od ludzi (RLHF).

Dane wejściowe : dodanie „wnioskować na podstawie danych wejściowych, które otrzymuje” podkreśla ważną rolę danych wejściowych, w tym reguł i danych,, które mogą zapewniać ludzie lub maszyny, w działających systemach AI. Mówi się, że system sztucznej inteligencji „wnioskowuje, jak wygenerować wyniki”, gdy otrzymuje dane wejściowe ze środowiska i oblicza dane wyjściowe, przetwarzając je za pomocą jednego lub większej liczby modeli i podstawowych algorytmów. Na przykład system wizualnego rozpoznawania obiektów zaimplementowany przez głęboką sieć neuronową dokonuje „wnioskowania”, tj . wnioskuje, w jaki sposób wygenerować wynik (w tym przypadku klasyfikację obiektu na obrazie) poprzez przekazanie danych wejściowych (pikseli obrazu) poprzez głęboką sieć (sparametryzowane wyrażenie algebraiczne składające się z dodawania, mnożenia i pewnych operacji nieliniowych).

Wyniki : dodanie słowa „treść” wyjaśnia, że zalecenie ma zastosowanie do generatywnych systemów sztucznej inteligencji, które tworzą „treść” (technicznie rzecz biorąc, podzbiór „przewidań, zaleceń lub decyzji”), taką jak tekst, wideo lub obrazy .

Środowisko : Zastąpienie „rzeczywistego” słowem „fizycznym” wyjaśnia i dostosowuje się do innych procesów międzynarodowych. Ponadto kontrastowanie rzeczywistości wirtualnej sugeruje, że środowiska wirtualne nie są rzeczywiste, co nie jest prawdą: są realne w tym sensie, że przyjmują rzeczywiste działania systemu AI i generują rzeczywiste bodźce sensoryczne do systemu AI.

Adaptacyjność : odzwierciedla to, że niektóre systemy sztucznej inteligencji mogą nadal ewoluować po ich zaprojektowaniu i wdrożeniu (na przykład systemy rekomendujące, które dostosowują się do indywidualnych preferencji lub systemy rozpoznawania głosu, które dostosowują się do głosu użytkownika) i stanowi dodatkową cechę charakteryzującą ważną grupę systemów sztucznej inteligencji . Ponadto poprzednie sformułowanie „działać na różnych poziomach” można odczytać jako opis pojedynczego systemu, którego poziom autonomii i zdolności adaptacyjnych może zmieniać się w czasie, co nie było zamierzonym odczytaniem.

Oprócz zmienionej definicji „systemu sztucznej inteligencji” OECD pracuje nad memorandum wyjaśniającym , które uzupełni definicję i zapewni dalsze zaplecze techniczne. Chociaż definicja jest z konieczności krótka i zwięzła, jej zastosowanie w praktyce będzie zależeć od szeregu złożonych i technicznych względów. Memorandum wyjaśniające będzie stanowić wsparcie dla wszystkich zwolenników zasad OECD dotyczących sztucznej inteligencji w lepszym wdrażaniu.

Zasady OECD dotyczące sztucznej inteligencji to pierwszy międzyrządowy standard dotyczący sztucznej inteligencji, przyjęty przez kraje OECD, a dokładnie Radę OECD na szczeblu ministerialnym, w dniu 22 maja 2019 r. Zasady mają na celu wspieranie innowacyjności i zaufania do sztucznej inteligencji poprzez promowanie odpowiedzialnego zarządzania godną zaufania sztuczną inteligencją przy jednoczesnym zapewnieniu poszanowania praw człowieka i wartości demokratycznych.

Uzupełnienie istniejących standardów OECD w obszarach takich jak prywatność, bezpieczeństwo cyfrowe,zarządzanie ryzykiem i odpowiedzialne prowadzenie biznesu, Zasady skupiają się na kwestiach związanych ze sztuczną inteligencją i ustanawiają standardy, które są możliwe do wdrożenia i wystarczająco elastyczne, aby przetrwać próbę czasu w tej szybko rozwijającej się dziedzinie.

W swoich postanowieniach końcowych Rada poleciła Komitetowi ds. Cyfrowej Polityki Gospodarczej, aby „monitorował, w porozumieniu z innymi właściwymi komitetami, wdrażanie niniejszego zalecenia i składał Radzie sprawozdania nie później niż pięć lat od jego przyjęcia, a następnie regularnie”.

W związku z tym przedstawiciele OECD i krajów członkowskich rozpoczęli prace nad tym raportem. W kontekście dyskusji kraje OECD zidentyfikowały we właściwym czasie możliwość utrzymania aktualności Zasad poprzez aktualizację definicji „systemu sztucznej inteligencji” i zgodziły się pilnie przeprowadzić tę aktualizację przed ukończeniem pełnego raportu na temat wdrażania, rozpowszechniania i znaczenia Zasad Zasady.

Aktualizacja definicji jest istotna merytorycznie, aby zapewnić jej ciągłość pod względem technicznym i odzwierciedlać ważny rozwój technologiczny, w tym w odniesieniu do generatywnej sztucznej inteligencji.

Ze strategicznego punktu widzenia byłaby to odpowiednia okazja do wspierania szerokiego dostosowania definicji „systemu sztucznej inteligencji” przyjętej przez OECD do bieżących procesów politycznych i regulacyjnych na arenie międzynarodowej, w tym w Unii Europejskiej i Japonii.

Ułatwiając takie dostosowanie, proponowana aktualizacja wzmacnia podstawową pozycję OECD i zasad sztucznej inteligencji w międzynarodowym krajobrazie zarządzania sztuczną inteligencją.

Źródło: materiały OECD.AI, zdjęcie zajawka: CC BY 2.0 DEED/Wikimedia.org

Prof. Stuart Russel z Uniwersytetu Kalifornijskiego w Berkeley uznawany jest za jednego z ojców sztucznej inteligencji.

Karine Perset to Kierownik jednostki ds. sztucznej inteligencji i OECD.AI

Marko Grobelnik – ekspert Laboratorium AI słoweńskiego Instytutu Józefa Stefana, badacz AI i mistrz cyfrowy

Zostaw komentarz

You must be logged in to post a comment.